KI Neuigkeiten

13 Feb. 2026

Read 9 min

KI Transkription in der Sozialarbeit: Wie Fehler verhindern

KI Transkription in der Sozialarbeit beschleunigt Dokumentation, verlangt aber auch klare Prüfprozesse.

Chancen und Risiken der KI Transkription in der Sozialarbeit

Wo Zeit entsteht

Viele Fachkräfte beschreiben spürbare Entlastung. Die Tools protokollieren, strukturieren und liefern Entwürfe für Berichte. Laut befragten Sozialarbeiterinnen und Sozialarbeitern fördert das sogar die Beziehung zu Klientinnen und Klienten, weil weniger nebenher geschrieben wird. Die KI Transkription in der Sozialarbeit wirkt hier wie ein Turbo für Dokumentation und Fokus im Gespräch.Wo Fehler passieren

Gleichzeitig zeigen die Fälle die Schattenseiten. In einem Fall erschien in der Zusammenfassung ein Hinweis auf Suizidgedanken, obwohl die Person das laut Protokoll nie erwähnt hatte. In anderen Mitschriften standen Begriffe wie „Fischstäbchen“ oder „Fliegen“, obwohl das Kind über Streit der Eltern sprach. Dialekte und regionale Akzente führten teils zu „Kauderwelsch“. In manchen Teams gilt das inzwischen als Bürowitz – bis ein Fehler Folgen hat.Konkrete Folgen für Praxis und Verantwortung

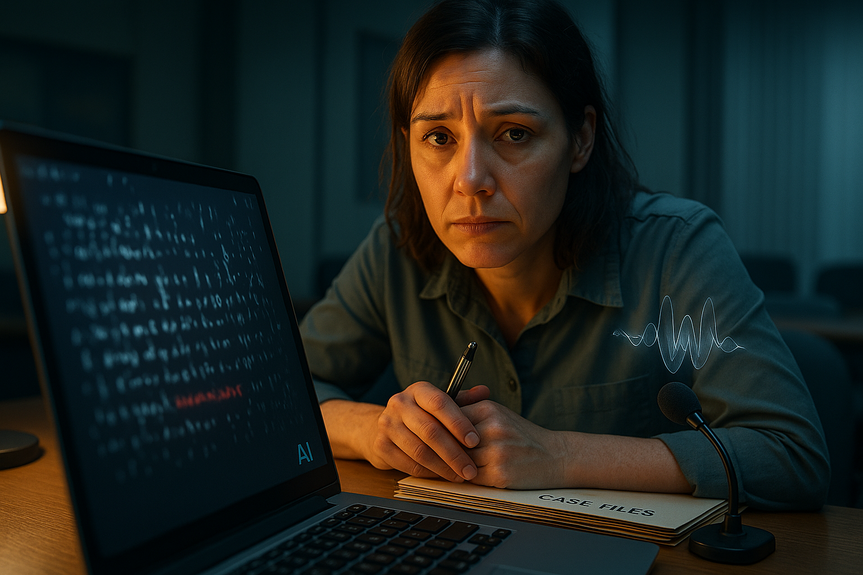

Entscheidungen und Haftung

Falsche Angaben in Akten können gefährlich sein: Ein übersehener Risikohinweis oder eine hinzugefügte Behauptung kann zu einer falschen Maßnahme führen. Die British Association of Social Workers berichtet von Disziplinarmaßnahmen, wenn Fachkräfte KI-Ausgaben nicht ausreichend prüfen. Andrew Reece warnt: Wer nicht selbst schreibt, verliert einen wichtigen Teil der Reflexion über das Gehörte.Training und Kontrolle

Die Studie zeigt große Unterschiede bei der Qualitätssicherung. Manche prüfen eine Stunde, andere nur zwei Minuten. Teilweise werden Entwürfe „kurz gescreent“ und dann direkt ins System kopiert. Das erhöht das Risiko, dass Fehler unbemerkt bleiben. Schulungen sind oft knapp – in einem Fall nur eine Stunde. So entsteht ein gefährlicher Mix aus Zeitdruck, neuen Werkzeugen und unklaren Standards. Genau hier muss die KI Transkription in der Sozialarbeit verbindliche Leitplanken bekommen.Werkzeuge im Einsatz und Reaktionen der Anbieter

Magic Notes und Copilot

Zahlreiche Kommunen – von Croydon bis Redcar and Cleveland – geben Zugang zu Transkriptionslösungen. Häufig genutzt werden Magic Notes und Microsoft Copilot. Magic Notes kostet laut Preisdokument zwischen £1,50 und £5 pro Transkriptionsstunde. Die Studie befragte 39 Fachkräfte, viele davon mit Erfahrung in einem der beiden Systeme.Was Anbieter sagen

Beam, Betreiber von Magic Notes, betont: Die Ausgaben sind erste Entwürfe, keine finalen Akten. Das Unternehmen verweist auf Prüfmechanismen gegen Halluzinationen und auf eine interne Bias-Bewertung. Zudem sei nicht jede KI gleich geeignet; spezialisierte Lösungen hätten Vorteile gegenüber generischen Tools. Zugleich bleibt klar: Ohne sorgfältiges Gegenlesen durch Menschen kann auch ein guter Entwurf schaden.So senken Teams Fehlerquoten

Prüfen statt kopieren

– Immer vollständiges Gegenlesen vor dem Speichern in der Fallakte. – Aussagen zu Risiko, Gesundheit oder Sicherheit extra verifizieren. – Auffällige Stellen (z. B. plötzliche Diagnosen, drastische Wertungen) markieren und mit Notizen belegen.Klare Standards im Team

– Mindestzeiten für die Prüfung festlegen (nicht „zwei Minuten“). – Checklisten für heikle Inhalte (Gewalt, Suizid, Kindeswohl). – Bei Akzenten oder schlechter Audioqualität auf langsamere, genauere Erfassung umstellen.Rollen und Verantwortung

– Die fachliche Bewertung bleibt beim Menschen; die KI liefert nur den Entwurf. – Kein Copy-and-Paste ohne Kontextprüfung. – Rückmeldungen zu Fehlstellen systematisch sammeln und an die IT bzw. den Anbieter geben.Kompetenz aufbauen

– Kurze, wiederkehrende Trainings statt einmaliger Einführung. – Beispiele aus der eigenen Praxis durchgehen: Was war korrekt, was war falsch, warum? – Funktionen der Tools nutzen, die Risiken senken (z. B. Halluzinations-Checks), und ihre Grenzen benennen.Politik und Rahmenbedingungen

Keir Starmer hatte die Technologie als großen Zeitgewinn gelobt. Die Untersuchung zeigt jedoch, dass Nebenwirkungen real sind. Imogen Parker vom Ada Lovelace Institute spricht von unzureichend bewerteten Risiken, die auf dem Rücken der Frontline landen. Berufsverbände fordern deshalb klare Leitlinien der Aufsichten: Wann ist der Einsatz angemessen? Wie wird geprüft? Wer trägt Verantwortung? Einheitliche Regeln würden Fachkräfte schützen und die Qualität sichern. Die Technologie bringt spürbare Vorteile, doch sie braucht menschliche Kontrolle, Training und klare Prozesse. Wenn Teams Prüfstandards fest verankern, Anbieter transparente Sicherheitsfunktionen liefern und Aufsichten Leitplanken setzen, kann KI Transkription in der Sozialarbeit Zeit sparen, ohne Sicherheit und Sorgfalt zu opfern.(Source: https://www.theguardian.com/education/2026/feb/11/ai-tools-potentially-harmful-errors-social-work)

For more news: Click Here

FAQ

Contents