KI Neuigkeiten

25 Feb. 2026

Read 8 min

Schatten KI im Gesundheitswesen: Vertrauen wiedergewinnen

Schatten KI im Gesundheitswesen eindämmen durch klare Zuständigkeit und Transparenz, Vertrauen wächst.

Was treibt Schatten KI im Gesundheitswesen?

“Shadow AI” meint den Einsatz von KI-Tools ohne formale Freigabe durch IT oder Sicherheitsteams. Dazu zählen Chatbots, Modelle zur Mustersuche und Visualisierungstools. Weil diese Anwendungen am Schutz vorbei laufen, drohen Datenschutz- und Compliance-Risiken. Laut Umfrage von Wolters Kluwer berichteten 40% vom Auftauchen solcher Tools in ihrer Organisation, 17% gaben zu, selbst welche zu nutzen.Warum greifen Mitarbeitende zu?

– Etwa die Hälfte: schnellerer Workflow – Rund ein Drittel: fehlende genehmigte Tools oder Funktionen – 26%: Neugier und Experimentieren Diese Motive zeigen: Es geht selten um Absicht, sondern um Effizienz. Genau hier setzt Governance an.Risiken und Kosten

– Patientensicherheit gilt als größtes Risiko – Durchschnittlicher Schaden eines Sicherheitsvorfalls im Gesundheitswesen: über 7,4 Mio. US‑Dollar (2025) – Fehlende Aufsicht erhöht die Gefahr von Datenabfluss, Fehlentscheidungen und Regelverstößen Die Ergebnisse unterstreichen, dass Schatten KI im Gesundheitswesen kein Randthema ist, sondern direkte Auswirkungen auf Sicherheit, Budget und Vertrauen hat.Transparenz und Zustimmung: Was Patientinnen und Patienten fordern

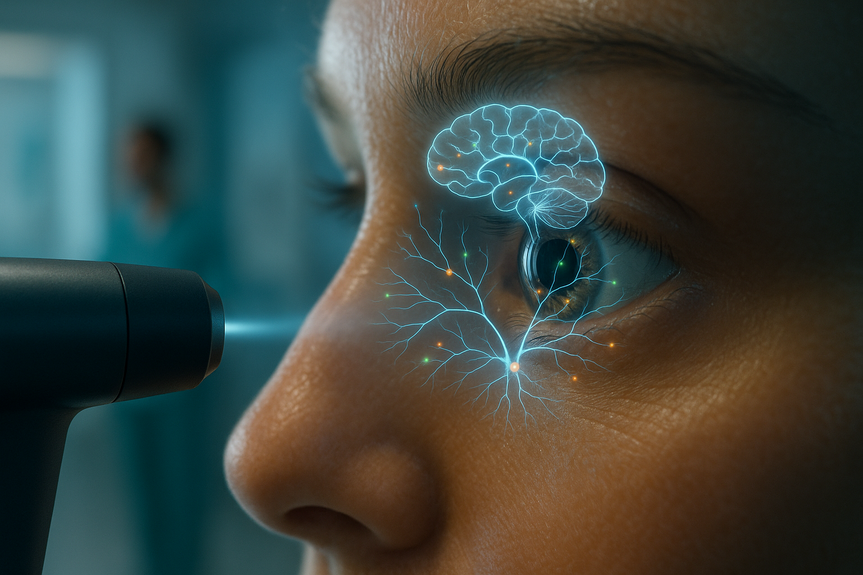

Die Coalition for Health AI (CHAI) befragte 1.456 Personen zu Vertrauen in Gesundheits‑KI. Drei Viertel nutzen KI absichtlich oder unabsichtlich, aber nur 13% fühlen sich sehr wohl damit. Über fast alle Anwendungsfälle hinweg bevorzugen Menschen ein informiertes Opt‑in, besonders bei mentaler Gesundheit, Versicherung und Diagnose. Jüngere, Haushalte mit niedrigerem Einkommen, weniger formaler Bildung sowie Black- und Hispanic‑Befragte zeigten besonders starke Opt‑in‑Präferenzen (~78%).Offenlegen und um Erlaubnis fragen

– 77%–85% möchten informiert werden, wenn KI Notizen schreibt, Diagnosen unterstützt oder Therapien vorschlägt – Rund 60% wollen vor der Nutzung um Erlaubnis gebeten werdenVertrauen ist fragil

– KI‑Einsatz steigert Vertrauen selten, teils sinkt es – 62% würden ihrer Versorgung weniger vertrauen, wenn KI Versicherungsleistungen mitbestimmt – 17% vertrauen etwas bis deutlich mehr, wenn KI bei der Zuordnung zu passenden Studien hilftDie Studie zeigt außerdem

– 64% sind offen, dass ihre Gesundheitsdaten die Versorgung verbessern; 35% lehnen das ab – Über 70% finden, dass Patientinnen und Patienten ihre Daten allein besitzen und kontrollieren sollten – 63% sorgen sich, dass Daten verkauft oder zu Profitzwecken geteilt werden (besonders 45–59 Jahre, einige College‑Erfahrung, Black- und Hispanic‑Personen, mittlere Einkommen) – 55% befürchten, dass KI Gruppen unfair behandelt – Größte Bedenken: übermäßige Abhängigkeit von KI statt ärztlichem Urteil, zu wenig menschliche Aufsicht, Missverständnisse und Fehler Diese Haltung erklärt, warum die Vertrauensfrage rund um Schatten KI im Gesundheitswesen so drängend ist: Ohne klare Regeln, Offenlegung und Mitsprache entsteht Ablehnung.So schließen Organisationen die Lücke

Die Wolters‑Kluwer‑Befragung zeigt eine Kommunikationslücke: 42% der Administratoren stimmen stark zu, dass KI‑Richtlinien klar kommuniziert sind; bei Behandlerinnen und Behandlern sagen das nur 30%. Empfohlen wird, systemweite Leitlinien festzulegen und diese sichtbar zu machen.Konkrete Schritte

– Klare Richtlinien: Was ist erlaubt? Welche Daten dürfen wohin? Wer trägt Verantwortung? – Transparente Prozesse: Kennzeichnung von KI‑Einsatz am Behandlungsfall; Möglichkeiten für Opt‑in/Opt‑out, wo sinnvoll und praktikabel – Genehmigte Alternativen anbieten: Wenn sichere, funktionale Tools verfügbar sind, sinkt der Reiz ungenehmigter Apps – Schulung und Feedback: Kurze Trainings zu Datenschutz, Bias und sicherem Prompting; Rückkanäle für Tool‑Wünsche – Monitoring und Reaktion: Meldestellen für Shadow‑Funde, zügige Bewertung und, falls geeignet, Integration in den offiziellen Werkzeugkasten So lässt sich Schatten KI im Gesundheitswesen eindämmen, ohne Innovation abzuwürgen. Ziel ist ein Rahmen, der Tempo, Sicherheit und Patientenschutz austariert.Story‑Ideen für Redaktionen

Vor Ort prüfen

– Wie unterscheiden sich die KI‑Richtlinien von Kliniken in Ihrer Region? – Wie klären Häuser Patientinnen und Patienten über KI‑Einsatz auf (Kennzeichnung, Einwilligung)? – Welche sicheren, zugelassenen Tools bieten IT‑Abteilungen als Ersatz für Schattenlösungen an?Betroffene zu Wort kommen lassen

– Pflegekräfte, die KI für Dokumentation testen – IT‑Sicherheit zu Vorfällen und Prävention – Patientinnen und Patienten zu Opt‑in, Datenhoheit und Fairness Am Ende geht es um Vertrauen. Die Daten zeigen: Menschen wollen Kontrolle, Transparenz und klare Zuständigkeiten. Wenn Häuser dies liefern, kann Schatten KI im Gesundheitswesen an Boden verlieren – und verantwortliche KI echte Vorteile bringen.For more news: Click Here

FAQ

Contents