KI Neuigkeiten

27 Jan. 2026

Read 14 min

GPT-5.2 Pro FrontierMath Ergebnisse: Wie Forscher profitieren

GPT-5.2 Pro FrontierMath Ergebnisse liefern Forschenden neue Lösungswege und verkürzen Prüfzeiten.

Was die GPT-5.2 Pro FrontierMath Ergebnisse zeigen

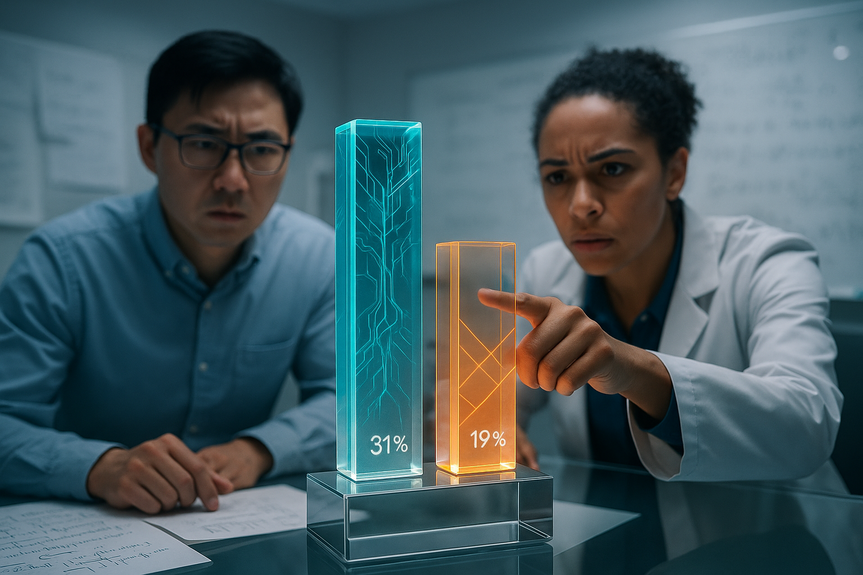

Die Zahlen sind klar. Auf Tier 4, dem schwersten Niveau im FrontierMath-Benchmark, erreicht GPT-5.2 Pro 31 Prozent. Das ist ein deutlicher Sprung gegenüber früheren Modellen. Gemini 3 Pro kam auf 19 Prozent. Eine Variante namens GPT-5.2 xhigh lag bei 17 Prozent. In Summe wurden 48 Aufgaben ausgewertet. GPT-5.2 Pro löste davon 15, darunter vier Aufgaben, die bislang kein Modell gelöst hatte. Diese Resultate zeigen zwei Dinge: – Das Modell verbessert die Erfolgsquote bei sehr schweren Aufgaben. – Es kann neue, bisher unlösbare Fälle knacken. Beides ist für Forscherinnen und Forscher relevant. Eine höhere Trefferquote spart Zeit bei der Suche nach Ideen. Neue Lösungen erweitern den Horizont und deuten auf neue Wege in der Problembearbeitung hin.Tier 4 als Härtetest

Tier 4 gilt in diesem Benchmark als härteste Stufe. Dass GPT-5.2 Pro dort am besten abschneidet, macht das Ergebnis aussagekräftig. Es zeigt, dass die Verbesserungen nicht nur einfache Standardaufgaben betreffen. Vielmehr geht es um schwierigere, forschungsnahe Problemstellungen, bei denen robuste Strategien, klare Argumente und genaue Begriffsarbeit zählen. Die Rückmeldungen aus der Mathematik-Community verstärken diesen Eindruck: Die Lösungen sind oft hilfreich, aber manche Erklärungen bleiben ungenau. Genau hier trennt sich nützliche Unterstützung von verlässlichem Beweis.Warum das für Forschende zählt

Für das Arbeiten in der Mathematik sind Tempo, Vielfalt der Ideen und die Fähigkeit, Sackgassen schnell zu erkennen, zentral. Die GPT-5.2 Pro FrontierMath Ergebnisse sind ein Signal, dass KI-Modelle bei all dem helfen können. Besonders bei Aufgaben, die sich an der Grenze des Bekannten bewegen, sind drei Eigenschaften wichtig: – Das Modell generiert alternative Ansätze, wenn ein Weg stockt. – Es bringt bekannte Methoden in neue Kombinationen. – Es hilft, Teilschritte zu ordnen und Hypothesen klar zu formulieren. Diese Unterstützung spart Recherchen und beschleunigt Iterationen. Wichtig bleibt aber: Die fachliche Verantwortung liegt bei den Forschenden. Jede Aussage muss überprüft werden, gerade wenn Erklärungen im Modelloutput an Präzision verlieren.Von der Heuristik zur Skizze

Viele mathematische Durchbrüche beginnen mit einer guten Heuristik. GPT-5.2 Pro kann dabei helfen: – Es schlägt mögliche Invarianten, Symmetrien oder Reduktionen vor. – Es formuliert Alternativen, wenn ein Beweisplan scheitert. – Es entwirft Skizzen, die sich später formal straffen lassen. So entsteht ein schneller Kreislauf: Ideenvorschlag, Gegenbeispielsuche, Verfeinerung. In diesem Kreislauf bietet das Modell Tempo. Die letzte Schärfung bleibt menschliche Aufgabe.Prüfbare Schritte und Dokumentation

Wo Präzision fehlt, hilft klare Struktur. Forschende können den Output besser nutzbar machen, wenn sie: – nach Definitionsschritten, Lemmas und klaren Übergängen fragen, – jede Behauptung nummerieren lassen und selbst prüfen, – Variablen und Randbedingungen exakt festlegen, – Alternativrouten dokumentieren, um später zu vergleichen. Diese einfachen Routinen machen Ergebnisse wiederholbar und senken das Risiko, dass ein kleiner Fehler den gesamten Beweisverlauf kippt.Erdős-Meldungen und der Realitätscheck

Berichte deuten darauf hin, dass GPT-5 teils eigenständig Erdős-Probleme gelöst hat und Forschende bei anderen Problemen unterstützte. Das passt zum FrontierMath-Bild: Die Modelle sind im Alltag nützlich. Gleichzeitig mahnt Terence Tao zur Vorsicht. Eine starke Punktzahl oder eine schnelle Lösung sagt noch nicht alles über Robustheit oder Neuheitsgrad aus. Es kann sein, dass ein Ansatz elegant wirkt, aber eine Lücke hat. Oder dass eine Lösung zwar funktioniert, aber einen bekannten Trick neu verpackt. Für die Praxis heißt das: – Erfolge als Startpunkt sehen, nicht als Endpunkt. – Beweisschritte streng prüfen, gerade an den Übergängen. – Positive Reviews schätzen, aber auf Details achten.Reproduzierbarkeit und Benchmark-Etikette

Epoch AI führte die Tests manuell über die ChatGPT-Website aus, weil die API Probleme machte. Das zeigt zwei Punkte: – Die gemessene Leistung ist stark, auch ohne fein abgestimmte Tools. – Für Nachtests sollten Eingaben, Einstellungen und Versionen offen gelegt werden. Wer in der Forschung mit KI arbeitet, kennt das Problem: Kleine Änderungen am Prompt oder der Umgebung können Ergebnisse verschieben. Darum empfiehlt es sich, bei der Nutzung solcher Benchmarks die eigene Dokumentation mitzuführen: -Datum, Uhrzeit und Modellbezeichnung festhalten -Prompts, Nachfragen und Temperatur-Einstellungen sichern -Ergebnisse in Versionen ablegen, um Änderungen nachzuvollziehen Je besser die Dokumentation, desto leichter lassen sich Ergebnisse replizieren oder verbessern.Praxisleitfaden: So nutzen Sie die GPT-5.2 Pro FrontierMath Ergebnisse in Ihrer Arbeit

Die Zahlen liefern ein klares Signal: Das Modell ist bei schweren Aufgaben hilfreich. So holen Sie strukturiert Nutzen heraus: – Problem zerlegen: Lassen Sie das Modell das Hauptproblem in Teilprobleme gliedern. Prüfen Sie jeden Teil auf Klarheit und Machbarkeit. – Hypothesen sammeln: Bitten Sie um mehrere plausible Hypothesen statt einer einzigen „besten“ Idee. Vielfalt schlägt frühe Fixierung. – Gegenbeispiele suchen: Fragen Sie das Modell aktiv nach möglichen Gegenbeispielen zu den eigenen Vorschlägen. So testen Sie die Stabilität früh. – Varianten vergleichen: Lassen Sie zwei bis drei Beweiswege skizzieren und vergleichen Sie Annahmen, Abhängigkeiten und Risiken. – Definitionsarbeit erzwingen: Bestehen Sie auf klaren Definitionen und sauberer Notation. Wo Begriffe unklar sind, drohen Fehler. – Schrittfolgen nummerieren: Bitten Sie um nummerierte Schritte und Begründungen. So fällt die Prüfung leichter. – Mathematisches Vokabular prüfen: Fragen Sie nach Quellen oder klassischen Resultaten, auf die sich der Schritt bezieht. Verorten Sie die Idee im bekannten Kontext. – Peer-Review im Kleinen: Holen Sie eine zweite Modellinstanz oder eine Kollegin dazu und lassen Sie gezielt nach Schwachstellen suchen. Diese Vorgehensweise passt zu dem, was die GPT-5.2 Pro FrontierMath Ergebnisse nahelegen: Nutzen Sie die Stärke des Modells bei schwierigen Aufgaben, aber halten Sie die Qualitätsprozesse fest in der Hand.Grenzen und Qualitätskontrolle

Die mathematischen Rückmeldungen machen es deutlich: Die Lösungen sind oft hilfreich, doch manche Erklärungen sind nicht präzise genug. Für die Forschung hat das drei Konsequenzen: – Präzision ist Pflicht: Jede Behauptung braucht klare Voraussetzungen und saubere Ableitungen. – Dokumentation spart Zeit: Eine lückenlose Notiz führt schneller zu belastbaren Resultaten. – Menschliche Prüfung bleibt zentral: Der Wert des Modells steigt mit der Strenge der Kontrolle. Wer diese drei Punkte beherzigt, kann die Produktivität deutlich steigern, ohne die fachliche Sicherheit zu riskieren.Ausblick: Was folgt nach dem Benchmark-Rekord?

Der Rekord auf Tier 4 zeigt, dass aktuelle Modelle in der Mathematik ernst genommen werden sollten. Sie sind nicht nur Spielerei. Sie liefern Ideen, Anstöße und manchmal echte Durchbrüche. Gleichzeitig bleibt es klug, zwischen Nützlichkeit und Gewissheit zu unterscheiden. Das gilt besonders, wenn Berichte über neue Lösungen die Runde machen. Die Verbindung aus starker Benchmark-Leistung und kritischer Prüfung durch Fachleute ist der Weg, der am meisten verspricht. Es spricht vieles dafür, dass kollaborative Arbeitsweisen gewinnen: Menschen bringen mathematische Intuition, Erfahrung und Rigorosität ein. Das Modell ergänzt Tempo, Variantenreichtum und Beharrlichkeit. Zusammen entsteht ein Kreislauf, in dem Ideen schnell wachsen, aber dennoch strengen Prüfungen standhalten. Genau dafür liefern die aktuellen Daten eine solide Grundlage. Zum Schluss bleibt das zentrale Bild: Die GPT-5.2 Pro FrontierMath Ergebnisse sind ein Fortschritt, der Forschenden konkrete Vorteile bietet. Wer die Stärken gezielt nutzt und die Schwächen bewusst absichert, kann mehr Ideen testen, schneller verwerfen und bessere Ansätze vertiefen. So wird aus einem Benchmark-Wert gelebte Praxis im Arbeitsalltag von Forschungsteams. (Source: https://the-decoder.com/openais-gpt-5-2-pro-solves-math-problems-that-stumped-every-ai-model-before-it/) For more news: Click HereFAQ

Contents