KI Neuigkeiten

19 Feb. 2026

Read 8 min

Klage gegen Google wegen Stimmenklau: Was jetzt zählt

Klage gegen Google wegen Stimmenklau erklärt welche Beweise zählen und welche Folgen Podcaster drohen

Klage gegen Google wegen Stimmenklau: Der Fall in Kürze

- Kläger: David Greene, Ex-Moderator von Morning Edition und Up First; aktuell Stimme von KCRW’s „Left, Right & Center“.

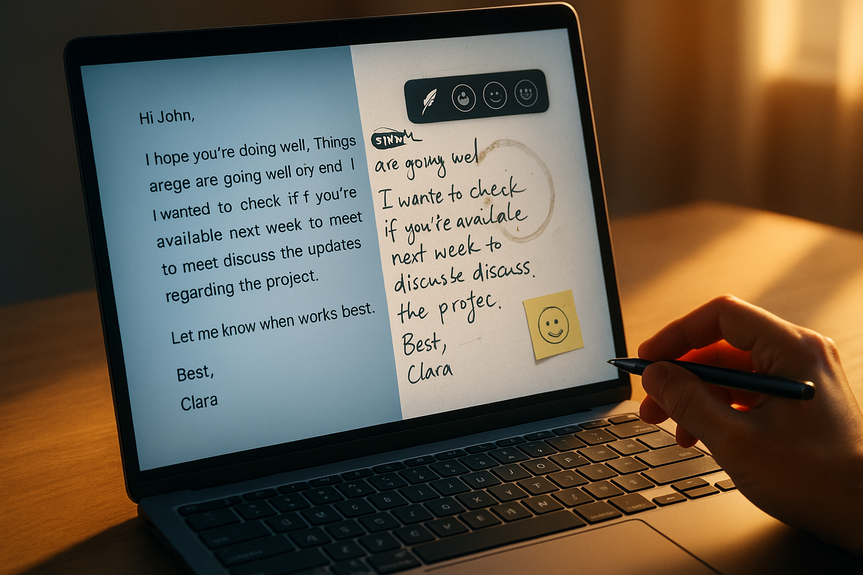

- Beklagter/Produkt: Google mit NotebookLM, einem 2024 gestarteten KI-Tool, das automatisierte Podcasts erstellt – mit einer männlichen und einer weiblichen Stimme, die miteinander sprechen („Audio Overviews“).

- Ort/Datum: Die Klage gegen Google wegen Stimmenklau wurde am 23. Januar in Santa Clara County, Kalifornien, eingereicht.

- Vorwurf: Die männliche Stimme klinge wie Greene – gleiche Kadenz, Intonation und Füllwörter („uhs“ und „likes“).

- Belege laut Klage: Ein ungenanntes KI-Forensik-Unternehmen habe eine 53–60%ige Wahrscheinlichkeit ermittelt, dass Greenes Stimme zum Training genutzt wurde; in der Klage als „relativ hoch“ bezeichnet. Konkrete Beweise legt die Klage nicht vor.

Wie alles begann

Ein früherer Kollege schrieb Greene nach dem Start von NotebookLM im Herbst 2024: „Hast du deine Stimme an Google lizenziert? Es klingt sehr nach dir!“ Danach wurde Greene mit ähnlichen Nachfragen überhäuft. Für ihn ist das Thema persönlich: „Meine Stimme ist der wichtigste Teil von dem, wer ich bin“, sagte er der Washington Post. Auch seine Frau habe verblüfft reagiert, als er ihr die KI-Passage vorspielte.Was genau behauptet die Klage?

Die Klage schildert, Google habe Greenes Stimme „gespooft“. Sie stützt sich dabei auf die Analyse der erwähnten Forensik-Firma. Diese Einstufung ersetzt aber keinen eindeutigen Nachweis. Das Verfahren soll klären, ob und wie Material von Greene zum Training genutzt wurde.Googles Antwort und offene Punkte in der Klage

Google weist die Vorwürfe entschieden zurück. Sprecher José Castañeda erklärte gegenüber der New York Post, die Anschuldigungen seien „grundlos“. Die männliche Stimme in den „Audio Overviews“ stamme von einem bezahlten professionellen Sprecher. In der Klage gegen Google wegen Stimmenklau bleibt damit zentral offen, ob Trainingsdaten von Greene tatsächlich verwendet wurden und wie die Stimmauswahl konkret erfolgte. Greenes Anwalt Joshua Michelangelo Stein (Boies Schiller Flexner) zeigte sich zuversichtlich und forderte die Öffentlichkeit laut Washington Post auf, sich die Beispiel-Audios selbst anzuhören. Gleichzeitig hält die Klage fest, dass sie derzeit keinen direkten Beweis liefert und die Forensik-Bewertung nur eine Wahrscheinlichkeit ausdrückt.Einordnung: Bekannte KI-Fälle rund um Stimmen und Bilder

Die Klage gegen Google wegen Stimmenklau reiht sich ein in eine Reihe prominenter KI-Streitfälle:- Scarlett Johansson und OpenAI (2024): Nach Veröffentlichung der ChatGPT-Stimme „Sky“, die der Schauspielerin ähnlich klang, drohte Johansson mit rechtlichen Schritten. OpenAI entfernte „Sky“ daraufhin.

- Deepfakes auf X (ehemals Twitter): Sexuell explizite KI-Bilder von Taylor Swift verbreiteten sich 2024 millionenfach. X entfernte temporär den Namen und verwandte Suchbegriffe, doch ein Bild hatte bereits 47 Millionen Aufrufe.

- Weitere Verfahren: Greenes Anwalt vertritt auch Buchautorinnen und -autoren wie Sarah Silverman und Ta-Nehisi Coates in einer KI-Urheberrechtsklage gegen Meta.

Was jetzt zählt

Die nächsten Schritte beobachten

Die Gerichte müssen klären, ob die Vorwürfe tragen und welche Rolle die Forensik-Bewertung spielt. Wichtig ist, ob zusätzliche Belege vorgelegt werden und wie Google die Herkunft und Auswahl seiner Stimmen dokumentiert.Transparenz über Stimmen und Trainingsdaten

Je klarer Unternehmen offenlegen, woher Stimmen stammen und wie sie eingesetzt werden, desto besser lassen sich Missverständnisse vermeiden. Das gilt besonders für Tools, die gesprochene Inhalte automatisch erzeugen und Dialoge simulieren.Präzise Kommunikation gegenüber Nutzern

Wenn Produkte wie NotebookLM mit „Audio Overviews“ arbeiten, hilft eine eindeutige Kennzeichnung: Wer spricht? Ist es ein Schauspieler? Wie wird KI eingesetzt? Das schafft Vertrauen, reduziert Risiken und schützt Identitäten. Am Ende wird entscheidend sein, wie Gerichte und Unternehmen mit ähnlich gelagerten Fällen umgehen. Wie die Klage gegen Google wegen Stimmenklau ausgeht, könnte Maßstäbe setzen – für Moderatoren, Kreative und Tech-Firmen gleichermaßen.For more news: Click Here

FAQ

Contents