KI Neuigkeiten

19 Feb. 2026

Read 15 min

LangGraph Streamlit Anleitung: Wie Sie Agenten kontrollieren

LangGraph Streamlit Anleitung zeigt, wie Sie Agenten planen, prüfen und erst nach Freigabe ausführen.

LangGraph Streamlit Anleitung für menschliche Freigabe und volle Kontrolle

Warum ein Mensch in der Schleife sein muss

Viele Agenten wirken wie Black Boxes. Sie handeln sofort, rufen Tools auf und hinterlassen unklare Spuren. Das birgt Risiken. In diesem Ansatz arbeitet der Agent offen: Er legt zuerst einen strukturierten Plan vor, stoppt dann an einer klaren Grenze und wartet auf Ihr „Ja“. So sehen Sie, was passieren soll, bevor etwas passiert. Genau darin liegt der Unterschied zwischen blindem Automatisieren und verlässlicher Zusammenarbeit.Was wir genau bauen

Die Anwendung ist ein Reise-Planungsagent in drei Phasen: – Planen: Das Modell erstellt einen JSON-Plan nach festem Schema (Reise, Budget, Tool-Aufrufe). – Prüfen: Ein LangGraph-Interrupt stoppt den Ablauf. In der Oberfläche sehen, bearbeiten und entscheiden Sie. – Ausführen: Erst nach Ihrer Freigabe ruft der Agent sichere, deterministische Tools für Flüge, Hotels und Tagespläne auf. Der Fokus liegt auf Transparenz, Nachvollziehbarkeit und Aufsicht. Diese Struktur hilft überall dort, wo Automatisierung Wirkung hat: vom Buchen bis zum Recherchieren.Einführung und Ziele

Diese LangGraph Streamlit Anleitung zeigt, wie Sie Agenten so entwerfen, dass Menschen stets die letzte Entscheidung haben. Der Kern: – Planung statt Freitext: Das Modell liefert einen validierten JSON-Plan. – Explizite Freigabe: Ohne „Approved“ keine Tool-Aufrufe. – Sichtbare Kette: Jeder Schritt ist im UI greifbar. Das System macht die Gedanken des Agenten sichtbar. So steigt das Vertrauen und Fehler lassen sich früh korrigieren.Setup und Umgebung

Abhängigkeiten installieren

Die Anwendung setzt auf wenige Bausteine: – LangGraph für den Ablauf (Graph, Nodes, Interrupt). – Streamlit für das UI. – OpenAI als Modell-Schnittstelle. – Pydantic für strikte Schemas. – Optional: localtunnel zur externen Freigabe der App. Die Installation erfolgt direkt im Notebook. Der API-Schlüssel von OpenAI wird zur Laufzeit sicher abgefragt und als Umgebungsvariable gesetzt. Als Standardmodell dient gpt-4.1-mini, sodass der Rest des Codes sauber und reproduzierbar bleibt.Sichere Konfiguration

– Schlüssel nicht hardcoden, sondern zur Laufzeit abfragen. – Das Standardmodell in einer Variablen wie OPENAI_MODEL setzen. – Alle späteren Schritte greifen darauf zu. Das vereinfacht Wartung und Wechsel. In der LangGraph Streamlit Anleitung installieren wir bewusst nur, was wir wirklich brauchen. Das hält die Umgebung schlank und reduziert Fehlerquellen.Sichere Tools als Bausteine

Warum deterministische Tools?

Die Anwendung simuliert externe Dienste, bleibt aber vollständig lokal lauffähig. Die Tools liefern feste, auditierbare Strukturen. So sehen Sie vorab, was ein Tool zurückgeben wird, und vermeiden Nebenwirkungen.Die drei Kernfunktionen

- Flüge suchen: Gibt sortierte Flugoptionen zurück, basierend auf Strecke, Reisedaten und Budget. Ergebnisse sind klar strukturiert und auf die Top-Optionen begrenzt.

- Hotels suchen: Erzeugt zwei passende Hotelvorschläge. Sortiert entweder nach Preis oder rückt bei „luxury“ teurere Optionen nach vorn. So bleibt das Verhalten erwartbar.

- Tagesplan entwerfen: Baut für die Reisedauer einen einfachen, aber brauchbaren Tagesablauf (Morgen, Nachmittag, Abend) mit Bezug zur Stadt und zum gewünschten „Vibe“.

Planen statt Raten: Das Schema

TravelPlan mit Pydantic

Der Plan basiert auf einem strikten Datenmodell. Das TravelPlan-Schema enthält Felder wie: – Titel, Start, Ziel, Daten – Anzahl Reisende, Budget, Präferenzen, „Vibe“ – Nächte im Hotel, optionaler Tagesumriss – Liste geplanter Tool-Aufrufe Pydantic prüft den vom Modell erzeugten JSON. Ungültige Pläne werden abgefangen. So sichern Sie zu, dass nur saubere Daten in den Ablauf gehen.Planerstellung mit OpenAI

Das System ruft das Modell über die Responses-API auf. Es erhält: – Eine Systemanweisung: „Erzeuge einen JSON-Plan nach Schema, kurz und realistisch.“ – Die Nutzereingabe: zum Beispiel „2 Personen, Berlin nach Rom, Budget 1500 USD.“ – Das JSON-Schema als Kontext: Damit das Modell das Format einhält. Der Rückgabewert wird auf den JSON-Block reduziert, geparst und gegen das TravelPlan-Schema validiert. Fehlt die Liste der Tool-Aufrufe, ergänzt das System sie automatisch (Flüge, Hotels, Itinerary). Damit existiert immer ein vollständiger Ausführungspfad. Mit der LangGraph Streamlit Anleitung setzen Sie also eine klare Grenze zwischen Textphantasie und prüfbarer Struktur.Der Ablauf in LangGraph

Klar getrennte Knoten

Der Graph besteht aus drei Schritten: – make_llm_plan: Erstellt den strukturierten Reiseplan. – wait_for_approval: Unterbricht den Ablauf und übergibt Plan und Botschaft („Bitte prüfen und freigeben“). – execute_tools: Führt bei Freigabe die Tools in der geplanten Reihenfolge aus. Der Schlüssel ist der Interrupt. Er schickt einen Payload mit Plan und Hinweis an das UI. Von dort kommt die Entscheidung zurück: Approved oder nicht, optional mit einem bearbeiteten Plan.Zustand und Sicherheitslogik

Der State ist typisiert und enthält user_request, plan, approval, execution. Beim Ausführen prüft der Code: – Wenn nicht genehmigt, dann kein Tool-Call. – Wenn genehmigt, nutze bearbeiteten oder ursprünglichen Plan. – Unbekannte Tools werden blockiert und mit Fehler gekennzeichnet. So bleibt der Agent robust. Er tut nur, was Sie ausdrücklich erlauben. Wie die LangGraph Streamlit Anleitung zeigt, wird Autonomie dadurch nicht blockiert, sondern gelenkt.Speichern und Fäden

Mit InMemorySaver lassen sich Zwischenstände halten. Ein Thread-Identifikator sorgt dafür, dass der Agent über mehrere Interaktionen hinweg konsistent bleibt. So verlieren Sie Ihren Kontext nicht, wenn Sie zwischendurch etwas am Plan ändern.Streamlit-Interface: Prüfen, Bearbeiten, Freigeben

Warum ein sichtbares UI Vertrauen schafft

Das Streamlit-Frontend macht den gesamten Plan sichtbar. Sie sehen Felder, Tool-Aufrufe und können Änderungen vornehmen: – Plan prüfen: Stimmt das Ziel? Passen die Reisedaten? – Plan bearbeiten: Budget anpassen, Vibe ändern, Tool-Liste kürzen oder erweitern. – Entscheidung treffen: Plan genehmigen oder ablehnen. Erst bei Genehmigung startet die Ausführung. Danach sehen Sie strukturierte Ergebnisse: – Top-Flugoptionen aus der Suche – Zwei Hotelvorschläge mit Preis und Notizen – Tagesblöcke mit Morgen-, Nachmittags- und AbendideenKontrollpunkt vor der Aktion

Die Oberfläche fungiert als klare Schranke. So verschiebt sich das Risiko weg von „Das Tool hat schon gebucht“ hin zu „Wir haben gemeinsam entschieden“. Das ist nicht nur angenehmer, sondern auch sicherer.Transparenz und Sicherheit als Prinzip

Warum Interrupts mehr als Technik sind

Interrupts sind hier ein Gestaltungselement. Sie sorgen dafür, dass: – Denken und Handeln getrennt sind. – Der Nutzer das „Warum“ vor dem „Was“ sieht. – Entscheidungen dokumentiert sind. Damit entsteht Rechenschaft. Die Kette ist klar: Nutzeranfrage → Plan → Prüfung → Freigabe → Ausführung → Ergebnis. Jede Stufe ist sichtbar.Defensives Design

Ein paar Regeln im Code machen den Agenten widerstandsfähig: – Validierter JSON-Plan statt freier Text. – Auto-Injektion fehlender Tool-Aufrufe. – Blocken unbekannter Tools. – Deterministische Tool-Ergebnisse. So wird aus einem neugierigen Helfer ein verlässlicher Partner.Praxisteil: Von der Idee zum laufenden Agenten

1) Umgebung aufsetzen

– Bibliotheken installieren: LangGraph, OpenAI, Streamlit, Pydantic. – Optional localtunnel, um das UI nach außen zu teilen. – OPENAI_API_KEY sicher abfragen, OPENAI_MODEL setzen (z. B. gpt-4.1-mini).2) Tools implementieren

– Flugsuche: liefert zwei günstigste Optionen mit Strecke, Datum, Preis. – Hotelsuche: wählt zwei Vorschläge, reagiert auf „luxury“. – Itinerary: baut für jeden Tag drei Blöcke (Morgen, Nachmittag, Abend). Alle Tools geben saubere, nachvollziehbare Strukturen zurück.3) Schema definieren

– TravelPlan mit Pydantic anlegen: Felder für Reise, Budget, Präferenzen, Tool-Aufrufe. – Das Schema dem Modell mitgeben, um die JSON-Form zu erzwingen.4) Plan generieren

– Responses-API aufrufen mit Systemprompt, Nutzerwunsch und Schema. – JSON extrahieren, parsen, validieren. – Fehlende Tool-Aufrufe automatisch ergänzen.5) LangGraph-Workflow bauen

– Node zum Planen, Node zum Warten (interrupt), Node zum Ausführen. – State mit user_request, plan, approval, execution. – InMemorySaver und Thread-ID nutzen, um Sitzungen konsistent zu halten.6) Streamlit-UI verknüpfen

– Plan anzeigen, Bearbeitung zulassen. – Buttons für Approve/Reject. – Nach Freigabe Tool-Ergebnisse strukturiert darstellen.7) Testen und teilen

– Anfrage formulieren (z. B. von Berlin nach Rom, vier Nächte, 1500 USD). – Plan prüfen, kleine Änderungen durchführen. – Freigeben und Ergebnisse ansehen. – Optional via localtunnel öffentlich machen.Wert für Teams und Produkte

Verlässliche Zusammenarbeit

Diese Architektur ersetzt blinde Autonomie durch überprüfbare Schritte. Teams können sie als Blaupause nutzen, wenn: – sensible Aktionen anstehen, – eine Freigabe-Pflicht besteht, – Ergebnisse protokolliert werden müssen.Ein Muster für viele Domänen

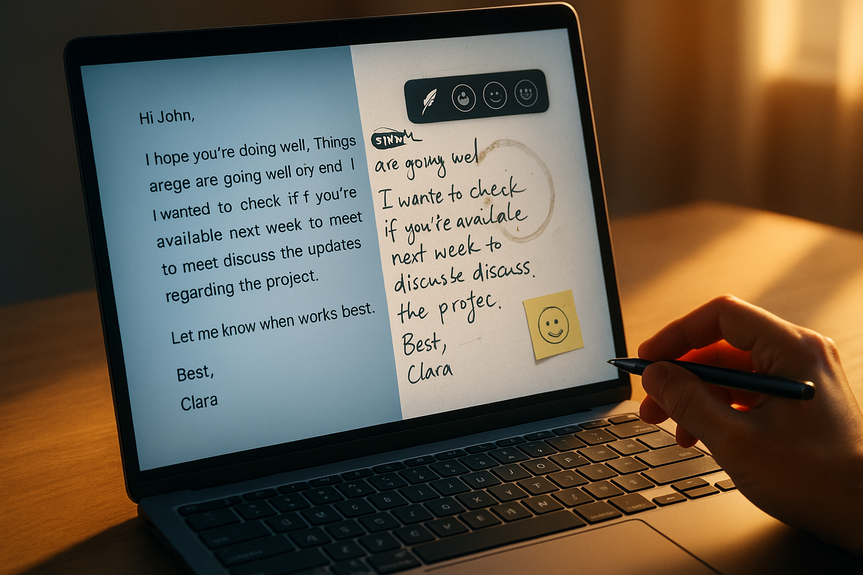

Reisen ist hier nur ein Beispiel. Überall, wo ein Agent nachgedacht hat, bevor er handelt, steigt die Qualität: – Recherche, die Quellen zeigt, bevor sie zitiert. – Datenabfragen, die SQL-Vorschläge zur Prüfung ausgeben. – E-Mail-Entwürfe, die im UI editiert werden, bevor sie rausgehen. Das gemeinsame Muster bleibt: Plan → Pause → Freigabe → Aktion.Tipps für robuste Implementierungen

Saubere Grenzen definieren

– Trennen Sie Modell-Planung, Nutzer-Entscheidung und Tool-Ausführung klar. – Halten Sie Datenwege strikt: Nur validierter Plan geht weiter.UI so einfach wie möglich halten

– Planfelder verständlich anzeigen. – Änderungen leicht machen (z. B. Budget, Vibe, Toolliste). – Deutlich kennzeichnen, was beim Klick auf „Approve“ passiert.Ergebnisse strukturiert zurückgeben

– Tools liefern konsistente Felder (z. B. airline, price_usd). – Sortierung nachvollziehbar machen (z. B. nach Preis). – Unbekannte Tools klar als „blockiert“ markieren.State bewusst verwalten

– Thread-IDs nutzen, damit Nutzerflüsse nicht verloren gehen. – Zwischenergebnisse speichern (InMemorySaver), um Wiederholungen zu vermeiden.Ausblick und Nutzen

Der hier gezeigte Ablauf macht Agenten kalkulierbar. Er schafft Vertrauen, weil Sie die Kontrolle behalten. Statt im Stillen Tools zu starten, legt der Agent seine Absicht offen und fragt nach. Genau das brauchen produktionsreife Systeme: Sichtbarkeit, Zustimmung, Protokoll. Diese Grundlage lässt sich erweitern, etwa mit weiteren Tools oder detaillierteren Plänen. Wichtig ist, dass das Muster stabil bleibt. Planen und Prüfen stehen vor jedem Aufruf. Erst danach folgt die Aktion. Am Ende sehen Sie die Vorteile sofort: – Weniger Fehlgriffe, weil nichts heimlich passiert. – Schnellere Korrekturen, weil der Plan editierbar ist. – Mehr Akzeptanz, weil Transparenz Vertrauen schafft. Mit dieser LangGraph Streamlit Anleitung setzen Sie einen klaren Standard: Agenten handeln nicht für uns, sondern mit uns – und zwar erst, wenn wir es wollen.For more news: Click Here

FAQ

Contents